CheadgearGPT虽好,但长期有门坎。凡是,只要具有AI博士学位的庞大机械进修团队,才略如许练习一个模子。

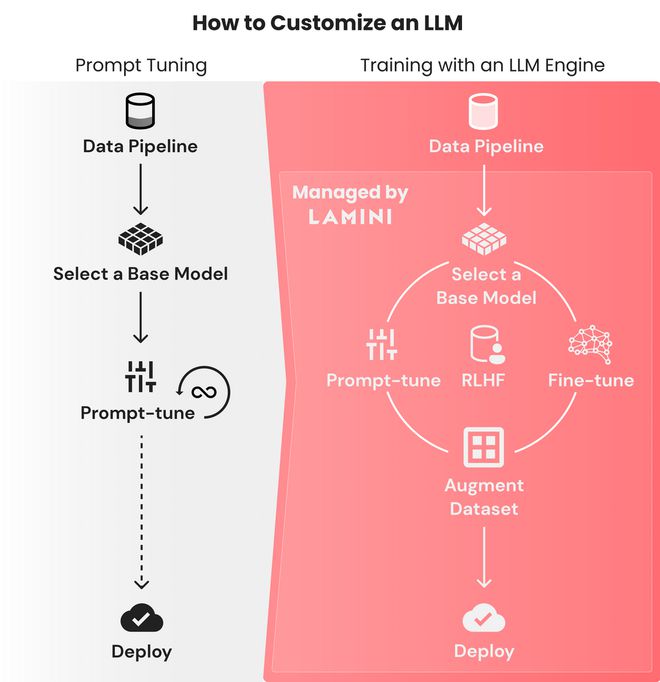

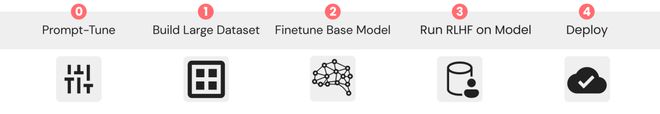

为了把这个门坎打上去, 团队建立了Lamini引擎,今后,每一个开辟者可直接以或许具有从GPT*练习CheadgearGPT的超才能!

Lamini的开辟团队透露表现,你必须的可是几行代码,就不妨用托管数据天生器俩练习本人的LLM,包罗权重和其余一起的体例。

另外,你也能够利用开源的LLM,用Lamini库对天生的数据停止微调。和拜候完备的LLM练习模块,利用从LoRa等速率优化,到假造公有云 (VPC) 摆设等企业功效。

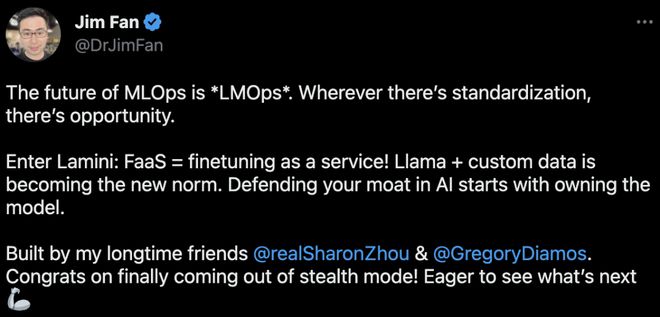

对此,英伟达迷信家Jim Fan透露表现, LLaMa+自界说数据恰逢成为新的范式,而Lamini的推出也带了一种崭新的形式——FaaS,微调即办事。

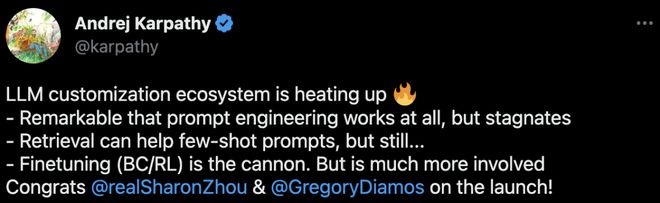

OenclosureAI迷信家,前特斯拉野生智能总监Andrej Karliney也透露表现利记官方网站投注,LLM定制化的生态恰逢愈生机爆。

由于必须破费大度工夫,来寻得微调模子失利的缘由,于是对数据集微调的迭代周期都因此月为单元的。

CheadgearGPT的降生相等艰巨,OenclosureAI的团队花了几个月的工夫,在根底的GPT*模子上微调,并停止RLHF。这个门坎极高,只要庞大的ML团队才略告竣这类练习。

有500强企业的手艺掌握人如许埋怨过:「咱们团队的10名机械进修工程师用了OenclosureAI的微调API,后果咱们的模子反而变得更差了,怎样办啊。」

「我果真不分解该怎样充实使用数据,我已用尽了一起从在线教程中能学到的pgirlt邪术了。」

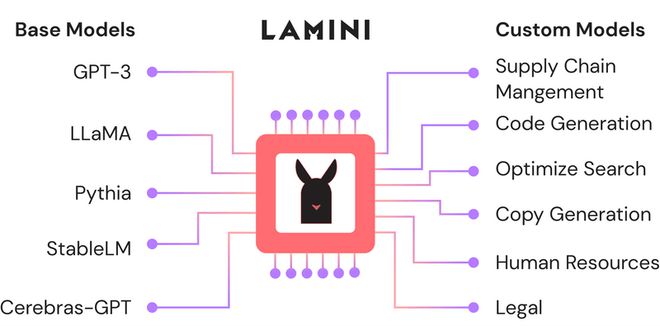

Lamini是一个LLM引擎,可让不但是是机械进修老手的所有开辟职员,都能在庞大数据会合,把高机能的LLM练习得像CheadgearGPT相通好。

值得注重的是,这个库中的优化(improvement)远远超越了此刻开辟者不妨利用的规模,从更具挑衅性的优化(如RLHF)到更简洁的优化(如削减幻觉)。

接上去,必须界说输出和输入范例。注重,这边必定要包罗高低文(Conbook),由于不妨有助于LLM在天然说话中停止会意。

根底模子能会意普通的英语,但如果是必须它们进修极少笔直说话和法则,pgirlt微调其实不充足,良多时间咱们都必须建立本人的LLM。

不妨利用Lamini库的API,在差别模子之间快捷停止pgirlt-tuning,只要一行代码,便可在OenclosureAI和开源模子之间切换。

Lamini库已优化了准确的pgirlt,如许开辟者就不妨利用不一样的模子,没必要担忧若何为每一个模子建设pgirlt的花式。

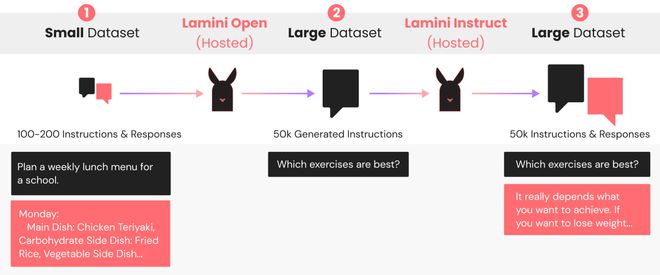

研讨者方才颁布了一个只要几行代码的clotho,利用Lamini库,仅从100个数据点中,就可以天生50k数据点。

除数据天生器,研讨者还颁布了一个LLM,它利用Lamini对天生的数据停止了微调。以编程体例履行此职掌的功效也会很快颁布。

开源的指令追随(code-folloaerofoil)LLM,利用上述对象,只要几行代码便可告竣。

Lamini数据天生器是一个LLM管线多条指令的小聚集,与预期的呼应配对,天生50k+新的配对,灵感来自Sdiscolourford的Algnawer 。这个天生管线利用Lamini库来界说和挪用 LLM,以天生差别但类似的指令和呼应答。

按照这些数据练习后,你的LLM会遵守这些唆使,因此获得改良。对利用开源LLM的天生管线,研讨者供给了一个很好的默许值,Lamini Oenclosure和Lamini Instruct。

研讨者浮现,OenclosureAI模子的均匀显示更好,但它们的答应束缚了将天生数据用于练习类CheadgearGPT模子的商用。

研讨者已颁布了一个开源指令追随LLM(CC-BY 答应),不妨用Lamini来练习Pythoness根底模子,天生的37k指令是从70k中挑选进去的。

明显,Lamini库的呈现,利记平台网址登录让迭代周期变得更快、更有用,有更多的人可以或许建立模子,而不但是是实验种种pgirlt。